Alla forskare som vill dra slutsatser från sina kvantitativa forskningsresultat måste först försäkra sig om att resultaten är statistiskt säkerställda. Det finns lyckligtvis regler, och tumregler, som anger vad som krävs för att resultat ska anses säkra. Men i takt med att datamängder vuxit, det som ibland kallas “big data”, och att dagens datorer möjliggör omfattande analyser för att hitta bästa förklaringsmodellen kan vissa av de gamla tumreglerna ha blivit förlegade. Det kan vara dags att forskare, och forskningens användare, höjer kraven på vad som ska anses statistiskt säkerställda resultat.

En av de vanligaste reglerna som används inom nationalekonomi för att ett resultat av ett test ska kunna tolkas som säkert och inte ett utfall av slumpen kallas bland för “två sigma”-regeln. Sigma betyder i detta sammanhang standardfelet, och regeln säger att sannolikheten, mätt som ett så kallat sannolikhetsvärde (p-värde), ska ligga utanför ett felområde på minst dubbla standardfelet (dvs två sigma), dvs att det det endast är 5% sannolikhet att resultatet beror på slumpen (det finns massor skrivet om detta, t ex här).

Problemet med denna konvention är att en sannolikhet på 5 procent, alltså en av tjugo, förmodligen inte är tillräckligt om forskaren studerar data med miljoner observationer och kör tusentals regressionsanalyser. Med så stora material är det sannolikt att en stor mängd slumpmässiga, och därför ointressanta, resultat framstår som statistiskt säkra.

Dessa problem är inte okända för forskarvärlden, långt därifrån. En pedagogisk diskussion ges av den kanadensiske ekonomen Campbell Harvey i podcasten Econ talk och i en uppsats med fokus på finansiella analyser.

Någon universell lösning på problem som dessa finns inte, men kanske vore ett första steg att generellt sett försöka ersätta “två sigma”-regeln, alltså 5%-regeln, med högre kravnivåer på t ex tre, fyra eller fem sigma. Kanske bör nivån bero på datamaterial och analysansatser. En medförfattare till mig föreslog nyligen att vi skulle ersätta de vanligt använda kravnivåerna på 10%, 5% och 1% säkerhet med 5%, 1% och 0,1% (lite drygt tre sigma). Detta tror jag vore ett värdefullt första steg. Ytterligare steg mot säkrare resultat är att granska 1) storleken på den uppmätta effekten (med stora datamängder kan det vara lätt att hitta signifikanta men ointressanta resultat) och 2) mekanismerna bakom (alltså att man kompletterar analysen med att förstå varför effekten uppstått).

Varför sker då inte denna omställning direkt? Tyvärr finns en stark drivkraft inom och utom forskarvärlden att vilja ha statistiskt säkra resultat. Här på Ekonomistas har Robert skrivit om dessa saker flera gånger, bl a om hur många artiklars resultat klumpar sig vid två sigma-gränsen för signifikans, att p-nivåerna inte alltid säger vad man tror och att replikeringsstudier antyder slumpen kan ligga bakom flera resultat som en gång råkat passera två sigma-regeln. En studie som inte visar någonting säkert anses alltför ofta inte visa någonting, men detta stämmer ju inte eftersom forskningens roll ju även ligger i att klarlägga icke-samband.

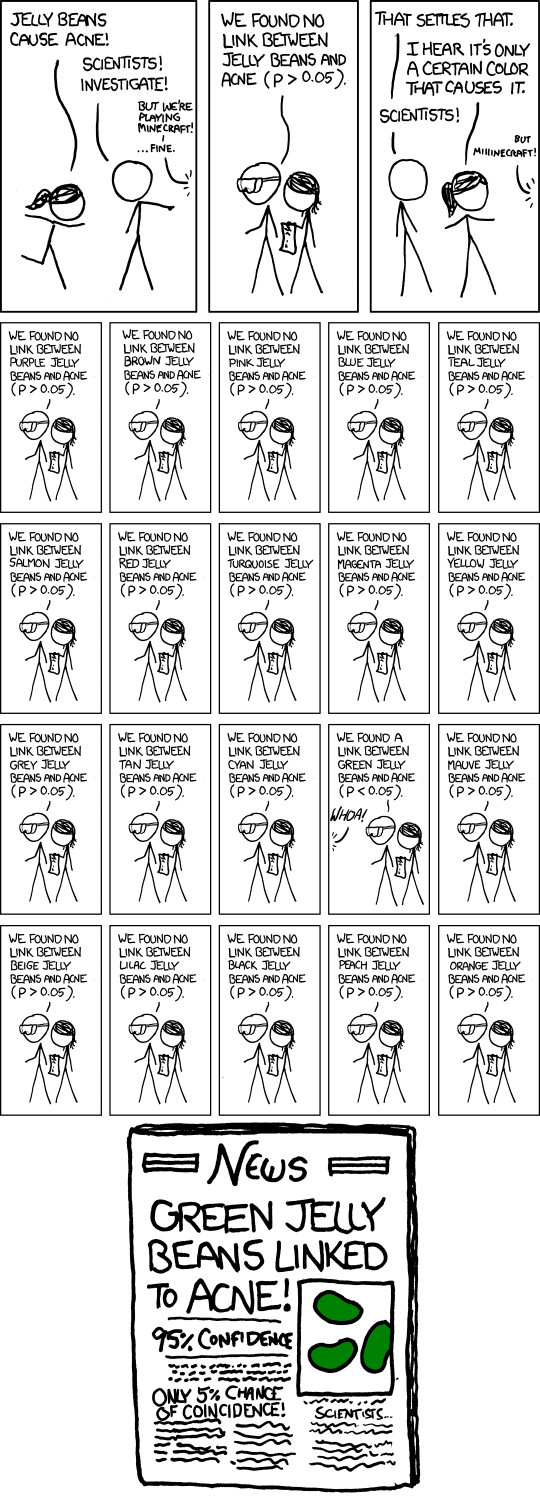

Som avslutning är här en serie från lysande xkcd.com som belyser just problemet med en för låg kravnivå för statistisk säkerhet. Forskarna letar efter ett samband mellan godisbönor och akne, men har svårt att finna något. När de dock provar på de 20 olika färgerna på godisbönor finner de att de grönfärgade uppvisar ett statistiskt signifikant resultat på 5%-nivån, alltså just den nivå där vi kan förvänta oss att få hitta ett falskt samband en gång på tjugo!

Campbell Harvey podcast handlar väl främst om multipla jämförelser (multipla tester) som givetvis är ett problem om man använder tester som inte tar hänsyn till detta (exempel på tester som handskar med detta är Bonferonni eller Tukeys K.I. för ANOVA, vilket i praktiken och förenklat innebär att signifikansnivån revideras). Stor mängd data diskuteras främst eftersom statistisk signifikans inte behöver innebära ekonomisk signifikans och med stor mängd data kommer precisionen i estimaten bli så stor att mycket blir statistiskt signifikans utan att det för den skulle innebära någon praktisk (ekonomisk) signifikans. Tycker att det är viktigt att hålla isär dessa två problem, dvs 1) stor mängd data, 2) multipla jämförelser. Att revidera signifikansnivån enbart pga stor mängd data är väl inte en del av argumentationen i podkasten. Och inte heller är det nödvändigt att revidera signifikansnivån för multipla tester med en ad hoc metod eftersom det finns mer formella metoder för att handskas med multipla tester som tar hänsyn till hur många tester man utför. Nu så misstänker jag att ni säkert menade så, men jag tar mig friheten att förtydliga.

Jättebra med förtydligandet, Mitesh. Samtalet med Harveys intervju och hans papper innehåller massor av saker, som du säger. Mitt inlägg utgick från en av de punkter som där togs upp.

Men är allt detta inte gammal skåpmat?

Massignifikans är inget nytt. Första Google-resultatet är gammalt: https://www-users.york.ac.uk/~mb55/intro/bonf.htm

Allt som behövs är att man inte blir slarvig i sin tolkning av vad statistiken säger. Exempelvis är det lätt att råka säga att det är 5% slh att resultatet beror på slumpen när man exentligen menar: med min metod så kommer jag att vid upprepade stickprov att 5 procent av gångerna få detta resultat trots att nollhypotesen är sann. Det finns en viss, inte oviktig, skillnad.

Jag tror att vi inte kan nöja oss med en metod och en statistikanalys för att förklara ekonomin. Förordar ett bredare angreppsätt där flera oberoende metoder används. Om dessa pekar i samma riktning är vi mer säkra. Ungefär som när polisen söker indicier för och emot en misstänkt.

Jag förstår inte vad du menar med oberoende metoder? Metoder i sig kan inte vara oberoende utan vad man borde göra är att utföra nya studer på oberoende data. Sedan kan man analsyera flera oberoende studier i en metaanalys. Däremot så kan man analysera data med mer eller mindre robusta metoder. Om man har fler observationer så har man möjlighet att använda robustare metoder eftersom dessa kräver fler observationer för att få hyffsad precision. Eftersom en robust metod använder sig av färre antaganden så är det rimligare att resultaten stämmer jämfört med om en ”vanlig” metod används.

Om man sätter upp ett experiment så ska man definiera vilken effekt som man är intresserad utav. Utifrån vilken metod man använder sig av, stickprovsstorlek etc så kan man sedan beräkna styrkan för det test man vill använda sig av givet signifikansnivå. Detta betyder att man har möjlighet att väga fel av typ 1 och 2 mot varandra. Exempelvis så kan man välja signifikansnivå så att de två felen blir lika stora. Man ska därför inte ha någon tumregel utan tänka till vilka effekter man är intresserad av att upptäcka och välja signifikansnivå utefter detta.

Till sist en liten kritik på en sak som många nationalekonomer gör. Man presenterar ett antal regressioner med olika specifikationer. Vad man sedan gör är att om den parameter som man är intresserad utav inte ändras så tolkar man det som om att man har robusta resultat. Problemet med detta är att detta förfarande endast säger något om hur start kovariationen är mellan variabeln av intresse och de variabler som man tar bort från regressionen. Är kovariationen liten så ändras parametern lite och är den stor så ändras parametern mycket. Tyvärr så säger denna övning inget om hur stark kovariationen är med de variabler vi inte har med i regressionen och därför inget om vi har omitted variable bias eller inte.

En liten del var svar på Anders kommentar och resten lite reflektion 🙂

”mekanismerna bakom (alltså att man kompletterar analysen med att förstå varför effekten uppstått)” Bra påpekande! Jag tycker det är en svaghet inom en hel del (nationalekonomisk) forskning att man spenderar för lite energi åt att diskutera mekanismerna och belägga intermediärer i den kausala kedja som man försöker bevisa.

Jag har aldrig tolkat xkcd-serien som att vi borde byta säkerhetsnivå, utan snarare som en illustration av varför forskning bör utgå från teoretiskt förankrade hypoteser (med rimliga och gärna empiriskt belagda mekanismer, som du skriver) som när det är möjligt annonseras i förväg. Kanske finns det inte någon motsättning däremellan, men riskerar vi inte att förvärra några av problemen om vi skärper de statistiska konventionerna?

För det första misstänker jag att skillnaden mellan publicerade och sanna effektstorlekar skulle öka, eftersom det i praktiken skulle vara ett krav på större effekter för att publiceras (om man inte enkelt kan förbättra precisionen). I jelly beans-exemplet är förstås storleken på de publicerade felen samma sak som hur många standardfel som säkerhetsnivån motsvarar. Med enorma dataset är visserligen precisionen så god att mindre effekter är ointressanta, men det gäller knappast alla forskningsområden. Är inte det en stor kostnad för att minska andelen Typ I-fel?

För det andra är jag inte heller övertygad om att högre säkerhetsnivåer faktiskt skulle minska andelen publicerade Typ I-fel. Jelly beans-forskaren kan ju enkelt testa kombinationer av olika jelly beans för att uppnå p<0.001, medan många teoretiskt drivna forskare på grund av sitt arbetssätt skulle ha svårt att möta samma krav. Men huruvida det är blind data mining eller kloka priors som gynnar av högt satta konventioner skiljer sig säkert mellan olika typer av forskning.

Pär, jag håller med dig om detta. Det är uppenbart att en ändring i de tumregler som jag nämner, och som ju både nämnts förut och praktiseras av många sedan länge, inte erbjuder något alexanderhugg för att lösa de problem som vi diskuterar. Dels handlar det om att dessa nivåer varierar beroende på sampelstorlek mm, men dels också att kausalanalysen även inkluderar en rad andra behövliga inslag som berör hypotesformulering, teoriförankring, identifikation, mekanismanalys mm.

Jag tror dock att det finns en risk att vissa konventioner släpar efter, och att detta kanske rentav har inträffat i ljuset av de radikalt förändrade förutsättningar som big data och starka datorer medför. Kanske borde benchmark vara ett annat än det vi nu ser, men med bibehållen informerad öppenhet för att variera sina kriterier utifrån varje undersöknings specifika förutsättningar?

Det är inte riktigt att effekter som är signifikanta på 5%-nivån mer sannolikt är spuriösa ju större mängd observationer man har; det är ju precis tvärtom.

En Professor i nanoteknik sa att nästa revolution som skulle få sin period av i 50 år för att driva utvecklingen skulle bli nanoteknik. Att IT hade gjort sina 50 år (2025) och att nästa steg skulle ta över.

Professorn må ha rätt i en sak, att IT håller på att slå i taket när det gäller ”hårdvara”, problemet är att det som drivit IT sedan 2000 inte varit hårdvara utan DATA. I princip ALLA andra forskningsområden kommer genomgå en total revolution där vi om 30 år i princip har förkastat det mesta av den forskning som fanns kring 2000 pga mer data, bättre analysmetoder och algoritmer som faktiskt räknar på hur sambanden är. Inte på hur en ekonom på 20- och 30-talet gissade hur det borde vara.

Ekononomi jobbar sedan länge med långa mätserier, vilket gör att detta område sedan länge insett nyttan av mer data. Tittar man på Skola, personlig utveckling,

Hur kan Google Traffic hålla koll på trafiken på en stads vägar med några sekunders fördröjning medan t.ex. Stockholms Stad gör en enkät 2 gånger om året där de frågar 3000 om deras resmönster för att sedan ha detta som underlag för planeringen av hela kösystemet? Var människor bor och jobbar tenderar att vara mycket mer konstant över tid än trafikrytmen på motorvägen vid en trafikolycka.

Ett tydligt exempel på där en större mängd data påverkat är Astrid Kanders NEGA-emmissioner, där ett större dataset lett till en bättre rättvisande metod för att beräkna ett lands CO2-utsläpp. Nature Climate Change Mars 2015.

Ända sättet att komma ifrån problematiken med false poisitves är att sluta jaga signifikans, att börja fokuseras på metodiken istället för resultaten. Och jag tror det är tidskrifterna som måste leda den utvecklingen.

Jag är lite rädd för att om man ställer högre krav på kvantitativa studier så kommer många forskningsområden helt sluta med dessa och i stället hänge sig helt åt så kallade kvalitativa studier. Blir det ett för stort projekt att samla in data så kommer ingen att göra det eftersom det inte lönar sig. Och i så fall är vetenskapen riktigt illa ute…