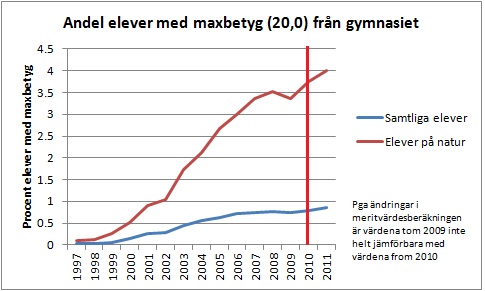

När jag 2008 började skriva om betygsinflationen på gymnasiet gick 0.76 procent av samtliga elever ut gymnasiet med maxbetyg. Bland eleverna från naturvetenskapligt program var andelen 3,5 procent. Det innebar att andelen hade ökat med 2400 respektive 3100 procent sedan 1997 då det målrelaterade betygsystemet infördes. Siffrorna för 2011 är nu preliminärt släppta av Skolverket och andelen med toppbetyg är nu uppe i 0,85 procent (en ökning med 2700 procent sedan 1997) bland samtliga och 4 procent bland naturstudenterna (3500 procents ökning).

I rättvisans namn ska sägas att meritvärdesberäkningen gjordes om år 2010 vilket gör att värdena till och med 2009 inte är helt jämförbara med värdena från och med 2010.* Vi ser dock en tydlig ökning av andelen toppelever på naturprogrammet mellan 2010 och 2011, vilket får en att tro att betygssättningen blivit allt generösare.

En alternativ förklaring vore att eleverna lär sig allt mer men fram till 2008 fanns inga tecken på detta: de bäst preseterande naturstudenternas (de i 95e percentilen) resultat i TIMSS sjönk i matematik med 0,55 standardavvikelser mellan 1995 och 2008 och i fysik med 0,5. Kanske ser det annorlunda ut därefter men då utvärderingar av kunskapsnivån i den svenska gymnasieskolan är sällsynta är frågan svår att besvara.

* Tom 2009 beräknades meritvärdet på samtliga kurser men from 2010 räknas tillvalskurser enbart in om de höjer meritvärdet. Förändringen påverkade inte bara beräkningen utan även eleverna incitament att läsa extra kurser.

Jag har pratat med lärare som påstår att betygsökningen faktiskt har skett medelst en enorm kunskapsförbättring. Tyvärr är denna nyvunna kunskap inte mätbar (typiskt!), och således resultaten från TIMSS.

Men det bådar förstås gott inför framtiden! Vi har en liga genier som snart tar över Sveriges näringsliv och förvaltning!

Vad beror det på ökningen av högsta betyg har varit så tydligt på natur? Har vi sett en sorts cream skimming så att en större andel av de bästa eleverna går på natur?

Eller har skolornas, sannolikt, ökade incitament att tillfredställa elever och föräldrar, bl.a. genom högre betyg, gynnat elever på natur i särskilt hög grad (utan att veta gissar jag att den gruppen är mer resursstark än gruppen som går t.ex. omvårdnadsprogrammet)?

Man kan möjligen tycka att seriösa forskare borde hålla sig för goda för att driva teser med hjälp av statistiska knep och tendensiös procenträkning. Sådan behöver förvisso inte vara felaktig i teknisk mening, men kan ändå vara vilseledande.

I Skolverkets ”Lägesbedömning 2011 del 1, Beskrivande statistik”, gymnasiedelen, kan man i tabell 6.11 se befintlig betygsstatistik för gymnasieskolan. http://www.skolverket.se/2.3894/publicerat/2.5006?_xurl_=http%3A%2F%2Fwww4.skolverket.se%3A8080%2Fwtpub%2Fws%2Fskolbok%2Fwpubext%2Ftrycksak%2FRecord%3Fk%3D2692

Av tabellen framgår att för NV-programmet var det 1997 sexton (16) elever som hade maximala betygspoängen 20,0. Tretton år senare 2010 var motsvarande antal 493. Detta ger som nämns i artikeln en procentuell ökning på cirka 3100 procent. Frågan är hur stor affär man ska göra av det. Om vi hypotetiskt antar att antalet med maxpoäng 1997 i stället hade varit 10 eller kanske bara 5 elever hade procentsatserna i stället blivit 4900 procent respektive 9800 procent. Hade detta ytterligare stärkt argumentationen om att ökningen är otillbörlig, dvs. ett uttryck för betygsinflation? Och hur stark hade den då inte blivit om antalet 1997 hade varit 0 elever.

Ett hederligare sätt att hantera frågan skulle vara att acceptera att systemet uppenbarligen var skakigt fram till 2003, men att betygen därefter i huvudsak stabiliserats när det gäller betygsmedelvärden på nationell nivå, vilket framgår av ovan refererade tabell. Orsakerna till denna utveckling från turbulens till (relativ) stabilitet är flera och kan diskuteras. Påtagligt är dock att betygsnivåerna på det hela taget legat förvånansvärt fast de senaste nio åren. För att motivera tesen om betygsinflation på nationell nivå måste man då hitta argument för att kunskaperna har minskat. Den enda studie som finns på gymnasienivå är den i artikeln refererade TIMSS-studien. Den är ett synnerligen osäkert instrument för att uttala sig om utvecklingen i gymnasieskolan under de senaste 10 åren. Jämförelsen med 1995 (då de deltagande eleverna läst matematik och fysik, vilket är de ämnen som prövas, enligt en annan kursplan och betygssatts enligt ett annat betygssystem) är av många skäl irrelevant, vilket man för övrigt kan konstatera om man läser rapportens avslutande kapitel.

Andelen elever med 20,0 har förvisso ökat även efter 2003. Mellan 2003 och 2010 med 2 procentenheter, från 1,73 till 3,75 procent på NV-programmet. Det är mer än en fördubbling av antalet elever. Men om denna ökning är ett uttryck för betygsinflation eller ett resultat av hårdare arbete, mer plugg eller något annat som ökat måluppfyllelsen, kan man i brist på tillförlitliga data bara gissa sig till. Sannolikt finns det inslag av både betygsinflation och ökade ansträngningar i bilden; då får man i stället gissa hur mycket av ökningen som beror på det ena eller det andra. Min gissning är 30-70, cirka…

Den som tycker att den svenska diskussionen om betygsinflation är ensidig och perspektivlös kan hänvisas till ett inlägg av en amerikansk ekonom. Inlägget är visserligen tio år gammalt, men eftersom vi brukar följa utvecklingen i USA med ungefär tio års eftersläpning och eftersom betygsinflation är en evigt återkommande fråga kan det ses som relevant.

http://www.epi.org/publication/webfeat_lessons20011205/

För en utbildning som naturprogrammet är det väl så att nästan alla gymnasister går vidare till högskolan/universitetet? En utveckling på slutbetygssidan borde kunna jämföras med högskola/universistets uppfattning om utvecklingen på ”kvaliteten” hos de nya studenterna.

Egentligen är det mycket anmärkningsvärt att inom högre utbildning så diskuteras knappt betygssystem alls, nationella prov saknas och lärare (och lärosäten) har stora friheter inom examination. Det ses som självklart, antar jag. Varför är major Björklunds närmast totalitära syn på gymnasiet så självklar åt andra hållet? Eller är den det?

Född i mitten på 70-talet ser jag tillbaka på min högstade- och gymnasietid som varandes ett under av enkelhet i dessa frågor. Det relativa betygssystem som då rådde påstods vara djupt orättvist. Ändå kan jag inte från hela min skoltid påminna mig om en enda person som skulle fått orättvisande betyg.

Kristian, om jag förstår dig rätt så är procenträkning skakigt eftersom procentförändringar beror på ursprungsnivåer (vilket gör den tendentiös); TIMSS är ”av många skäl irrelevant”, och att man därför måste ”gissa hur mycket av ökningen som beror på det ena [inflation] eller det andra [kunskap]”, samt att din ”gissning är 30-70”.

Briljant! Då nöjer vi oss med det. När är presskonferensen?

Pontus: Ok, men lite av poängen som jag tycker Kristian för fram (och som är relevant) är varför betrakta ”1997” som året då betygsättning var ”korrekt”. Med de nya målrelaterade betygen är det väl rimligt att man gjorde mer ”fel” i början och att betygsättningen nu är bättre. Det skulle tala för att den generösare betygsättningen är helt korrekt utifrån det målrelaterade betygsystem vi har, och att det var betygsättningen i slutet av 90-talet och början av 00-talet som var snett ute (med för skarp tolkning av målen för MVG).

Jag har inte invändningar mot bloggarens tolkningar som jag upplever rätt neutrala, men många som kommenterar och diskuterar betygsinflationen gör dem med en implicit indignation över hur ”fel” allt har blivit och att det är alldeles för lätt att få MVG idag. Om detta vet vi intet, åtminstone inte baserat på denna typ av statistik, utan kanske var det just ”för svårt” för 15 år sedan (och underlaget från TIMMSS är inte helt klockrent, trots allt).

Däremot stämmer det med mina helt ovetenskapliga observationer; att vi fått en något större klick hyper-ambitiösa elever som jobbar mycket hårt för högsta betyg (det verkar ju bli större variation på det mesta av ungdomars beteende; fler som inte super alls samtidigt som det är fler som super hejdlöst o s v, för att ta ett annat exempel). Denna grupp ”hyper-ambitiösa” kanske inte slår igenom i TIMSS eller PISA (där väl högpresterarna också blivit sämre), eftersom det väl tyvärr kan vara så att strategier som är betygsmaximerande inte alltid på marginalen innebär (tyvärr) högre (hållbara) kunskaper (som ex. testas i TIMSS.

MS: Jag kan helt klart köpa argumentet att betygen är mer korrekt satta nu än tidigare. Det är svårt att inta en position i den frågan.

Men vad som är mycket viktigare är givetvis att undersökning efter undersökning pekar på ett ganska rejält fall i svenska elevers kunskaper. Att vifta bort dessa med icke-argument, anklaga forskare inom området för att bedriva tendentiös forskning, för att sen ge sig på rena gissningar där man antar att kunskaperna faktiskt har ökat, istället för minskat, känns inte som den enda framkomliga vägen.

Kristian, du skriver:

”Den enda studie som finns på gymnasienivå är den i artikeln refererade TIMSS-studien. Den är ett synnerligen osäkert instrument för att uttala sig om utvecklingen i gymnasieskolan under de senaste 10 åren. Jämförelsen med 1995 (då de deltagande eleverna läst matematik och fysik, vilket är de ämnen som prövas, enligt en annan kursplan och betygssatts enligt ett annat betygssystem) är av många skäl irrelevant, vilket man för övrigt kan konstatera om man läser rapportens avslutande kapitel.”

Avser du någon annan rapport en den som Jonas Vlachos länkade till? Jag kan inte se att det avslutande kapitlet i den rapporten delar din invändning. Visst diskuteras en mängd olika aspekter, men samtidgt slås fast att ”Att resultaten så som de prövas i TIMSS Advanced 2008 sjunkit kraftigt för de elever i gymnasiet som läser avancerad matematik och fysik är obestridligt.” Då kan man möjligen invända att de svenska eleverna under perioden blivit bättre på något annat, men det görs knappast i kapitlet. I stället fokuseras på möjliga förklaringar till fallet i kunskaper.

Niklas: Det är riktigt det du skriver, och jag förnekar inte att de kunskaper TIMSSadv mäter hade sjunkit väsentligt mellan 1995 och 2007 och att det aktuella kapitlet beskriver olika anledningar till detta. Det som är relevant i det här sammanhanget är att betygen såväl 1997 som 2010 inte sätts utifrån TIMSS ramverk (kursplan) utan utifrån Lpf 94s kursplaner. Dessa skiljer sig som beskrivs, i det refererade kapitlet, avsevärt från kursplanerna i Lgy 70, vilka var de som legat till grund för de elever som presterade goda resultat i TIMSS 1995. De förklaringar som ges i TIMSS-rapporten gäller alltså dessa kursplaneskillnader och ska ses som förklaringar till varför resultaten på TIMSS 95 och TIMSS 2007 skiljer sig. Det man alltså kan säga är att elever som läste enligt Lpf 94 hade avsevärt lägre kunskaper 2007 än elever som läste enligt Lgy 70 år 1995 om man mäter utifrån TIMSS ramverk. Betygen 1997 och 2010 sattes dock i båda fallen, inte enligt TIMSS ramverk utan enligt kursplanerna i Lpf 94. Det är därför TIMSS inte är relevant (annat än som underlag för diskusion) för att jämföra betygssättning 1997 och 2011. TIMSSadv var en mätning mellan två skilda system, inte två mätningar inom samma (betygs)system. Därför är TIMSS til stor del var irrelevant för att mäta betygsförändring inom nuvarande betygssystem.

Betygsinflationen är visserligen ett problem men resultaten i TIMSS indikerar ett större problem. Vilka var tomtarna som låg bakom lpf 94?

Kristian, jag är medveten om det och jag delar synen att man inte kan ta för givet att den andel som fick högsta betyg 1997 är den korrekta andelen. Man kan ju mycket väl tänka sig att en av tankarna med det förändrade betygssystemet var att fler skulle ha MVG än den andel som haft 5,0, men att detta inte uppfylldes inledningsvis. Helt orimligt är en sådan strävan kanske inte heller. Ser man till hur stor del av NV-programmets elever som skriver MVG, VG respektive G på de nationella proven i t ex Ma C och D, framstår i mitt tycke inte andelen MVG idag som orimligt hög när det bara finns tre olika nivåer av godkänt. Man kan dock undra hur stor andelen skulle ha varit om kunskapsnivån varit högre. Det framstår som inte som troligt att man införde ett nytt system som var designat för ett framtida kunskapsfall. Då lär man ha haft en god spåkula.

Men i vilket fall så visar det på att betygssättningen inte varit konsekvent över åren, oavsett om det beror på att elever i början av perioden fått för låga betyg eller om elever fått för höga på senare år. Det förädrar knappast allvaret i problematik.

Niklas: Vad som var den rätta andelen MVG 1997 visste ingen. Riksdag och regering ansåg nämligen inte att det behövdes några kriterier för betyget MVG utan att lärarna genom sin professionalitet själva kunde avgöra detta. De kriterier som fanns för G och VG var i sin tur inte lätta att tolka entydigt, milt uttryckt. Dessutom ansåg regeringen inte heller att det behövdes några nationella prov eftersom det i det nya systemet fanns tydliga mål och betygskriterier. Under en övergångstid skulle dock proven få vara kvar (som bekant är de fortfarande kvar och ökar i antal). Att som lärare sätta rättvisa och likvärdiga betyg under dessa föutsättningar var naturgitvis omöjligt. Ganska naturligt vände man sig mot det bekanta, dvs. det relativa betygssystemet för att få någon form av vägledning. Eftersom betyget 3 krävdes för behörighet till högskolan föll det sig naturligt att det skulle motsvara G i den ny skalan. Därmed föll det sig också naturligt att 4 blev VG och 5 MVG. 1 och 2 fick motsvara IG. Detta kan också förklara varför andelen 20, 0 1997 nära överensstämde med andelen 5,0 i det tidigare relativa systemet.

Efter några år kom nationella kriterier också för MVG. Detta tillsammans med en del andra förändringar, tydligare nationella prov och en efterhand etablerad praxis gjorde att den nationella betygsnivån började stabiliseras kring 2000 (vilket visar sig i betygsstatistiken för 2003 då eleverna lämnade gymnasiet). Men som många rapporter visat betyder det inte att allt är frid och fröjd.

Någon bestämmelse om hur stor andel som t.ex. ska ha MVG i det målrelaterade systemet finns förstås inte. Ambitionen är snarast att andelen ska bli så stor som möjligt, men då förstås utifrån att det motsvaras av ökade kunskaper. Hur detta ska säkras utan att åtgärderna samtidigt ska hämma elevernas lärande och kunskapsutveckling är själva kärnfrågan i sammanhanget.

Jo, jag vet att det saknades vettigt underlag under de målrelaterade betygens inledande period och jag delar uppfattningen att det gör det mycket vanskligt att använda denna period som riktmärke. Frågan är dock om betygsinflationen verkligen planat ut de senaste åren. Jämförelser över tiden (TIMSS, PISA, etc) tyder på sjunkande kunskaper hos svenska elever, alltså borde också betygen ha försämrats. Jag vet att det riktas invändningar mot dessa jämförelser. Det är dock inte rimligt att agera först när vi har fullständigt vattentäta belägg på att elevernas kunskaper sjunkit i alla avseenden.

I flera avseenden är man ju på gymnasiet i händerna på grundskolan, i så måtto att ju sämre kunskaper eleverna har med sig från grundskolan, desto svårare blir det att nå långt med dem under de tre åren i gymnasiet. Finns det goda skäl att tro att kunskaperna sjunkit i grundskolan får vi ha som arbetshypotes att betygen på gymnasiet borde sjunka. Finns det dessutom underskningar som tyder på att gymnasieelever har fått sämre kunskaper framstår en sådan arbetshypotes som än rimligare.

Först underlåter Skolverket att följa kunskapsutvecklingen i skolan och sedan tar man denna underlåtelse till intäkt för att ifrågasätta de belägg för sjunkande kunskap som kommer från annat håll. Därmed har man under lång tid kunnat dölja att man misslyckats med att få betygssystemet att mäta elevernas faktiska kunskapsutveckling, vilket var ett av huvudsyftena när man lämnade det relativa betygssystemet. En viss ödmjukhet hade man kunnat förvänta sig från personalen på en myndighet med detta track-record.

Niklas, instämmer i det mesta av det du säger. Dock är det tveksamt om man kan generalisera resultat från PISA och TIMSS i grundskolan till den elitgrupp i gymnasiet som strävar efter 20,0. Det har skett olika förändringar i antagningen till högskolan som kan antas ha ökat intresset att ta sig in på prestigeutblldnangarna via betyg. T.ex. har det bli svårare att komplettera betyg, den nya betygsskalan gör det svårare att få maxbetyg och fr.o.m. ht 11 har den kvantitativa delen av högskoleprovet utökats. Detta talar för ytterligare ökning av 20,0 (eller egentligen 22,5 med meritämnen). Men vilken betydelse sådana faktorer verkligen har vet vi inte.

Betyg och nationella prov visar ingen nedgång i gymnasiet. TIMSS och PISA visar nedgång i grundskolan och TIMSSadv indikerar nedgång i gymnasiet. Det finns ytterligare en möjlig indikator för gymnasiet nämligen KTHs nybörjartest i matematik. http://www.lilahe.com/KTH2011.pdf

Diagram 8 visar hur lösningsproportionerna förändrats över tid för elever med samma betyg. Tabell 12 komplicerar bilden.

Det finns alltså motstridiga signaler så visst är det rimligt att ha som arbetshypotes att det förekommer betygsinflation. Problemet är att verifiera eller falsifiera antagandet. I allmänhet framställs dock inte betygsinflation som en hypotes utan som ett belagt faktum. Detta riskerar att bli självuppfyllande. ”Om ingen annan håller igen på betygen, varför ska jag göra det?”

Jonas, jag har som jag tidigare nämnt inget mandat att yttra mig för Skolverket (om det är det du tror jag gör). Och enligt min mening är ett ödmjukt förhållningssätt att inse svårigheter och vara försiktig med kategoriska slutsatser.

Ytterligare en komplicerande faktor är att KTH sedan 2007 erbjuder en förberedande kurs som ges innan förkunskapsprovet. Det förefaller rimligt att en sådan kurs kan kompensera för brister i kunskaperna från gymnasiet.

Absolut, det var en nyhet för mig.

Det där var ju faktiskt en riktigt intressant rapport från KTH. Det är förstås intressant att se att studenter med G i betyg 1999 får ett bättre resultat än studenter med VG 2011. På motsvarande sätt får studenter med VG i betyg 1999 mer eller mindre samma resultat som de med MVG 2011.

I alla fall på KTH så har betygen devalverats en helt steg.

Kristian: ang tabell 12 i KTH-rapporten du länkar till, vet vi något om fördelningen mellan vilka typer av gymnasieprogram de olika grupperna (3 resp 5 år på högskolan) gick i? Det kan ju faktiskt vara så att den tabellen bara bekräftar den gamla skrönan att en viss kunskapsnivå på ett visst program inte alltid motsvarar samma betyg i samma kurs på ett helt annat program?

Eller tänker jag helt fel?

x: Jag har inga uppgifter på hur de antagna fördelar sig på olika gymnasieprogram. Flertalet kommer säkerligen från NV och en mindre del från Teknik-programmet. Till det ska läggas att minst en tredjedel kommer in via högskoleprov och i vilken utsträckning dessa skaffat behörighet via gymnasieprogram, komvux, bastermin, basår eller på annat sätt måste man nog fråga KTH eller VHS om. Men i vilket fall torde det vara svårt att dra några rimligt säkra slutsatser utifrån den tämligen lilla självselekterade gruppen i tabell 12.

Kristian Ramstedt: den sista artikeln du referar till är intressant, den väcker ju frågan vad vi ska ha betygssystemet till. Att visa upp för arbetsgivare att man uppnått vissa mål? Det fungerar det säkert bra för.

Att däremot bygga något slags antagningssystem för vidare studier där hälften av alla betyg är det högsta verkar inte helt optimalt….

Pontus: Jag uttryckte mig tydligen oklart så låt mig förtydliga. Det är just när forskare, som i forskningssammanhang är mycket noggranna och korrekta, i debattsammanhang uttrycker sig på sätt som de knappast skulle göra i en vetenskaplig rapport som jag tycker det finns anledning att reagera. Jag har alltså inte uttryckt några som helst invändningar mot Jonas Vlachos forskning.

Jag trodde också att ”min gissning” skulle tjäna som en illustration till hur lite belägg det finns för den ena eller andra uppfattningen. Så låt mig också här förtydliga; jag vet förstås lika lite som andra vad ökningen av 20,0-elever beror på.

Eftersom Skolverket och det pedagogiska forskarsamhället inte bekymrat sig om att följa gymnasisternas kunskapsutveckling så finns naturligtvis en viss osäkerhet kring denna. TIMSS är dock bättre än en ren gissning (och visst är det hur som helst allvarligt om den ”nya” gymnasieskolan ledde till kraftigt sjunkande matematik- och fysikkunskaper bland de elever som valt natur). Notera dock att det är TIMSS i 95e percentilen jag talar om; bland genomsnittsstudenten har resultaten fallit med ca 0,9 standardavvikelser. Så de högpresterare som eventuellt preseterar bättre måste vara ytterst få.

Kristian invänder mot procenträkningen men man kan samtidigt konstatera att ökningen i absoluta tal är större mellan 2003 (då systemet skulle stabliserat sig) och 2011 än vad den var mellan 1997 och 2003. Jag vill även framhålla att andelen med 5,0 i det relativa betygssystemet var konstant över tid och i nivå med andelen 20,0 år 1997. Kristian säger vidare att man måste hävda att kunskapsnivån fallit för att kunna tala om betygsinflation. Visst, men detta är precis vad vi sett på högstadiet: enligt PISA har resultaten fallit med ca 0,25 standardavvikelser mellan 2000 och 2009 i åk 8. Under denna tid har betygsmedelvärdet på högstadiet varit konstant, eller svagt ökande. Att det skulle kunna vara på samma sätt på gymnasiet förefaller knappast orimligt.

Trots att poängen med det målstyrda betygssystemet var att fånga faktisk, snarare än relativ kunskap, så har vi ingen som helst aning om hur betygen förhåller sig till faktisk kunskap. Det är ett stort misslyckande och jag anser att Skolverket är huvudansvarigt för detta då det ligger i myndighetens uppdrag att följa hur skolsystemet fungerar. Ett annat stort problem är att så mycket av lärarnas tid går åt till att tolka betygskriterier och försöka lösa den olösliga knuten att utan normering nå likhet i bedömningen mellan landets alla lärare och skolor. Ansvaret för detta är främst politiskt då det skulle kräva regelförändringar för att skapa sådan normering.

Jag har ytterst svårt att se vad en 10 år gammal artikel om betygsinflation på Harvard har med saken att göra. Vi har i Sverige en central högskoleantagning vilket gör gymnasiebetygens likvärdighet viktig på ett annat sätt än betygen från amerikanska elituniversitet. (Vissa spelar high school GPA roll även för elituniversitetens antagning, men de som ansvarar för denna är väl medvetna hur betyg sätts på olika skolor runt om i landet.) Däremot är Betts forskning (som citeras i artikeln och som jag tidigare nämnt här på bloggen) intressant då den visar att betygsinflation i sig leder till sjunkande kunskapsnivåer.

Slutligen: jag har tidigare inte specifikt lyft fram resultaten för naturstudenterna just pga de förändrade selektionsmönster som eventuellt finns. Andelen som går natur är lägre idag än 1997, vilket skulle kunna betyda att genomsnittsstudenten som gått natur är bättre än tidigare, vilket i sin tur skulle kunna förklara en del av den kraftiga ökningen av toppstudenter just på detta program. Under de senaste åren har dock andelen varit relativt konstant. Samtidigt ska man ha i åtanke att en sådan selektion gör att kunskapsfallet enligt TIMSS (som endast görs av naturstudenter) faktiskt underskattar det verkliga kunskapsfallet.